BMVC2019论文。CSDN可以参考论文解析。

现有实时语义分割网络大多采用two-branch的结构,一路在高分辨率上采集空间信息,一路downsample后在低分辨率上采集语义信息,然后使用某种新奇方法融合两种不同形式特征,从而兼顾高低分辨率、高低层次信息,使得网络可以达到实时计算并且精确度不错。

下面三幅图是本文主要强调的三种2-branch的结构图。![]()

![]()

![]()

论文网络结构如下,![]()

- Adding few layers after the feature fusion module boosts the accuracy

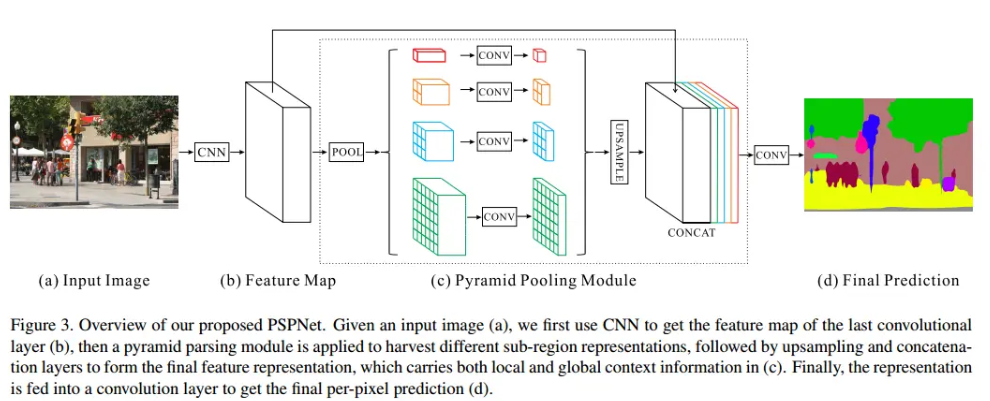

PPM模块如图:

在特征融合上,论文进行相加,避免引入过多参数量。

State of art 的方法如 BiSeNet, GUN等都使用了 two-branch 网络。我们的 learn to downsample 模块和它们的 spatial path 等价,因为它们都很浅,从全分辨率输入上学习,用在特征融合模块中(图1)。

我们的全局特征提取模块和这些方法中的较深的低分辨率 branch 等价。但是,我们的全局特征提取器将它前几个层的计算与 learn to downsample 模块进行了共享。通过共享这几个层,我们不仅将第了特征提取的计算复杂度,也将第了输入的大小,Fast-SCNN 使用1/8的分辨率,而不是全局特征提取阶段的1/4分辨率。

Fast-SCNN 可被看作 encoder-decoder 方法的特例,如 FCN 或 U-Net。但是,不像FCN中的 multiple skip connections 或者 U-Net 中的 dense skip connections,Fast-SCNN 只使用了单个 skip connections 来降低计算量和内存消耗。

这篇论文从另一个角度展示了two-branch的设计方法,还是有借鉴意义的。提示我们,不同深度上的特征可以进行不同程度的复用,然后再进行融合。